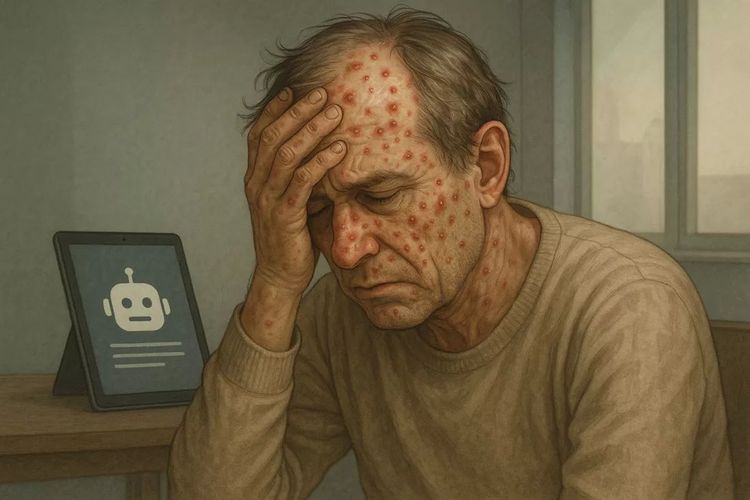

Kasus Pria AS yang Dirawat di Rumah Sakit Akibat Ikuti Saran ChatGPT

Seorang pria berusia 60 tahun dari Amerika Serikat (AS) harus menjalani perawatan selama tiga minggu di rumah sakit setelah mengikuti saran diet dari chatbot AI milik OpenAI, ChatGPT. Kejadian ini menunjukkan pentingnya kewaspadaan dalam mengambil saran kesehatan dari sistem otomatis tanpa melibatkan ahli medis.

Pria tersebut awalnya meminta bantuan ChatGPT untuk mengubah gaya hidupnya, termasuk mengganti asupan garam dapur yang biasanya mengandung natrium klorida (NaCl). Menurut Pusat Pengendalian dan Pencegahan Penyakit AS (CDC), konsumsi garam berlebihan dapat meningkatkan tekanan darah dan berisiko menyebabkan serangan jantung atau stroke. Hal ini menjadi alasan utama bagi pria tersebut ingin mengganti garam dengan alternatif lain.

Setelah berkonsultasi dengan ChatGPT, ia menemukan bahwa natrium klorida bisa diganti dengan senyawa natrium bromida. Ia langsung membeli produk yang mengandung zat tersebut secara online tanpa berkonsultasi dengan dokter dan tanpa menyadari potensi risiko kesehatannya.

Natrium Bromida: Dulu Digunakan sebagai Obat, Kini Berbahaya

Natrium bromida pernah digunakan sebagai obat penenang pada abad ke-19 hingga awal abad ke-20. Namun, saat ini, senyawa ini hanya digunakan untuk pengobatan kejang pada hewan peliharaan seperti anjing dan kucing. Selain itu, natrium bromida juga digunakan dalam beberapa produk kebersihan, termasuk produk perawatan kolam renang.

Menurut National Library of Medicine (NLM), konsumsi natrium bromida secara terus-menerus dapat membahayakan kesehatan manusia. Efek yang muncul antara lain gangguan pada sistem saraf dan kulit.

Kondisi Memburuk dan Diagnosa Bromisme

Setelah mengonsumsi natrium bromida selama tiga bulan, kondisi pria tersebut semakin memburuk. Ia akhirnya dilarikan ke Instalasi Gawat Darurat (IGD) rumah sakit. Gejala awal yang dialami termasuk rasa haus ekstrem, kelelahan, halusinasi, serta ruam di kulit. Meski haus, ia menolak air yang diberikan karena takut tidak bersih.

Selama masa perawatan, pria ini juga mengalami psikosis berat dan perilaku aneh, termasuk mencoba kabur karena ketakutan. Dokter kemudian memberikan obat penenang dan melakukan pemeriksaan laboratorium lebih lanjut.

Hasil uji laboratorium menunjukkan bahwa kadar bromida dalam tubuhnya mencapai 1.700 mg/L, jauh di atas batas normal sekitar 0,9–7,3 mg/L. Untuk mengurangi kadar bromida, dokter memberikan cairan dan elektrolit agar senyawa berbahaya ini keluar melalui urin.

Pria ini akhirnya didiagnosis mengidap Bromisme, sebuah penyakit langka akibat paparan bromida berlebihan dalam jangka panjang.

ChatGPT 3.5 atau 4.0 vs GPT-5: Perbedaan Respons

Setelah dirawat, pria ini mengakui kepada dokter bahwa ia menggunakan ChatGPT dan mengikuti saran untuk mengganti natrium klorida dengan natrium bromida. Namun, para dokter tidak memiliki akses ke percakapan tersebut.

Studi dari Annals of Internal Medicine: Clinical Cases menemukan bahwa ChatGPT memang menyarankan natrium bromida, tetapi tidak memberikan peringatan kesehatan yang cukup. Ini membuat pria tersebut yakin bahwa senyawa tersebut aman untuk dikonsumsi.

Namun, versi terbaru ChatGPT, yaitu GPT-5, menunjukkan peningkatan respons yang lebih spesifik dan penuh peringatan. Ketika ditanya apakah bisa mengganti natrium klorida dengan natrium bromida, GPT-5 menegaskan bahwa senyawa tersebut tidak aman untuk dikonsumsi harian dan bisa menyebabkan komplikasi kesehatan.

ChatGPT Tidak Menggantikan Profesional Medis

Meskipun model AI semakin pintar, OpenAI menegaskan bahwa ChatGPT tidak boleh digunakan sebagai pengganti tenaga medis profesional. Sistem ini hanya bisa menjadi mitra untuk membantu pemahaman hasil atau mengajukan pertanyaan yang tepat, selama pengguna tetap bekerja sama dengan penyedia layanan kesehatan.

OpenAI juga menyatakan bahwa ChatGPT “tidak ditujukan untuk diagnosis atau perawatan kondisi kesehatan apapun”. Mereka menekankan bahwa pengguna bertanggung jawab atas segala penggunaan Layanan dalam konteks medis.

Pentingnya Kewaspadaan dalam Mengikuti Saran AI

Peristiwa yang dialami pria tersebut menjadi peringatan bahwa saran dari AI, meskipun tampak masuk akal, belum tentu aman atau teruji secara klinis. Terutama ketika berkaitan dengan senyawa berbahaya dan kesehatan tubuh, konsultasi dengan ahli medis tetap menjadi prioritas utama.